2026 年 3 月 20 日,华为中国合作伙伴大会 2026 期间,以 “与时代,共昇腾” 为主题的昇腾人工智能伙伴峰会在深圳成功举行。华为昇腾计算业务总裁张迪煊发表《一起昇腾,共赢行业智能化》主题演讲,指出 AI 正从生成式 AI 迈向 Agentic AI,2026 年将成为强化学习及 Agent 应用规模落地元年,昇腾将打造大、中、小三大核心算力场景,携手伙伴共探行业智能化落地加速路径。

华为昇腾计算业务总裁 张迪煊

一、开源开放筑生态,昇腾与伙伴携手共赢

2025 年是昇腾沉淀技术、拥抱开源的关键一年,同年 8 月昇腾正式宣布 CANN 和 Mind 系列软件全面开源开放、架构解耦,并积极向业界贡献关键特性。其中,联合科大讯飞落地的大 EP 技术贡献至 vLLM 社区,填补了业界多机推理加速能力的空白。

目前昇腾已向三方社区累计贡献超 11 万行代码,在毕昇编译器层构建 AscendNPU IR 平滑对接 Triton,兼容 FSDP2、vLLM 等 50 多个主流开源社区和项目,实现开源模型 0day 支持,让开发者可快速落地训练与推理创新。同时,众多 SOTA 开源模型基于昇腾原生孵化,如智谱基于昇腾仅三个月完成的多模态大模型 GLM-Image,开源 24 小时即登顶 Hugging Face Trending 榜第一。

在一体机产品领域,昇腾在 DeepSeek 发布后快速推出参考配置,使能 80 多家伙伴 2 周内发布自研产品。一年时间里,已有 350 多家伙伴打造 400 多款行业场景一体机,服务 2700 多家客户,占据国内一体机市场 80% 以上份额,加速大模型行业落地。

二、AI 迈入 Agentic 时代,2026 成强化学习 + Agent 应用落地元年

过去三年 AI 行业实现跨越式发展:2023 年 “大模型元年” 让模型从感知理解走向生成创造;2024 年 “大模型推理元年” 确立 Tokens 为 AI 时代新量纲;2025 年国产大模型开源爆发,Tokens 使用量席卷千行万业。

当前 AI 正式迈入 Agentic AI 时代,实现从 “会聊天” 到 “能办事” 的升级。To C 端,OpenClaw 成为现象级开源应用,短时间内收获超 32 万 star、百万新增用户,国内头部互联网纷纷布局智能体入口;To B 端,AI 深度渗透生产决策环节,强化学习成为基座模型落地行业核心场景的必选之路,而海量 Tokens 成为核心支撑,其计算效率直接决定企业核心收益。

三、大中小系列化算力开放,适配全场景差异化需求

结合 AI 发展趋势与客户需求,昇腾打造三大核心算力场景,全方位满足行业差异化需求,助力伙伴深耕行业智能化:

- 大算力场景:聚焦大模型预训练、强化学习后训练及大规模推理服务,昇腾将打造领先超节点架构及产品,开放灵衢协议、部件及参考架构,赋能企业重塑核心业务;

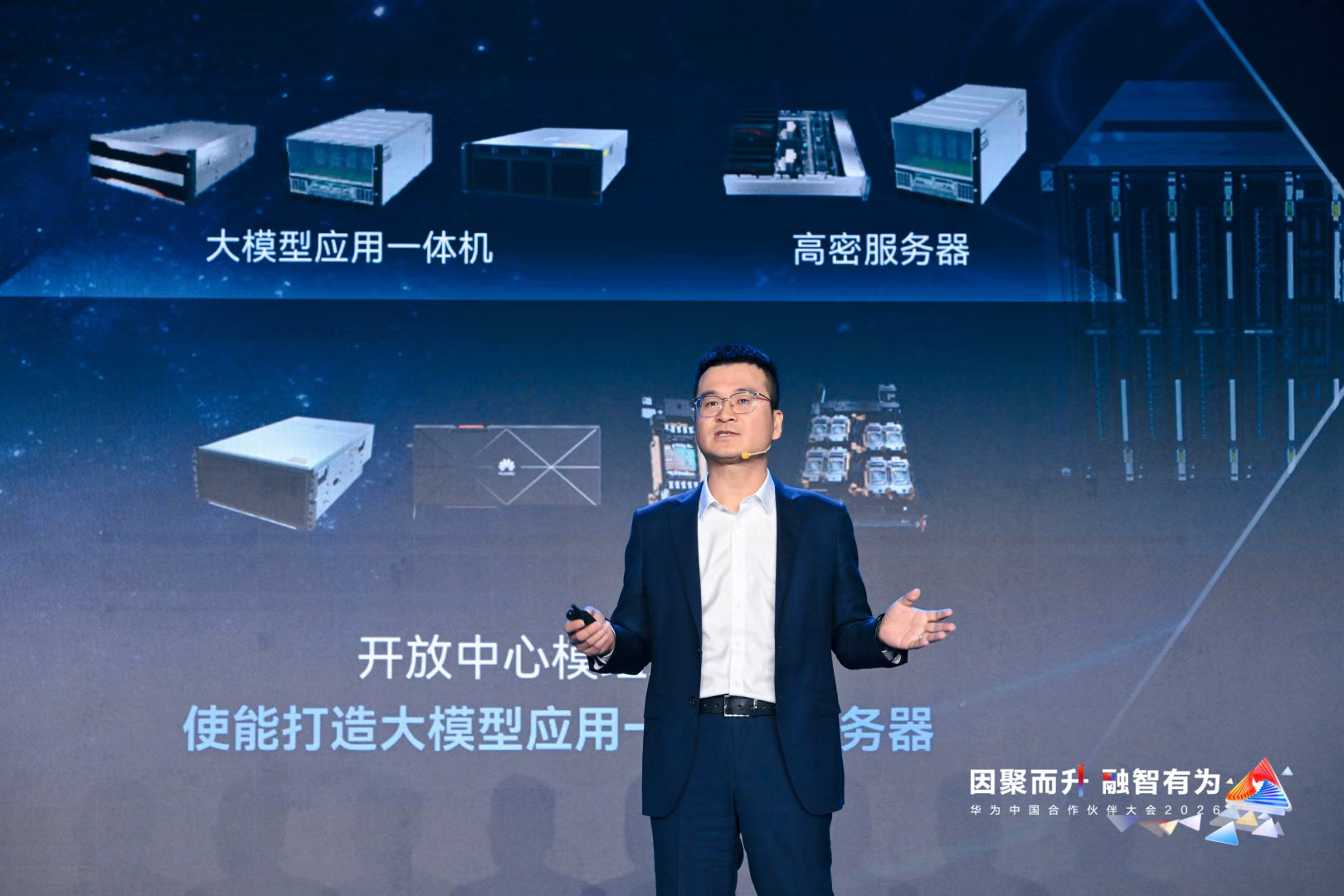

- 中算力场景:覆盖辅助医疗、智慧教学等主流行业应用,围绕 “开箱即用” 打造 “快速部署 + 成本可控” 的平衡,开放中心模组 / 刀片,支持伙伴打造大模型应用一体机、高密服务器;

- 小算力场景:聚焦工业质检、具身智能、科研教学等智能边端领域,针对客户 “灵活高效、成本可控” 的诉求,开放标准模组和板卡,使能伙伴打造多样化边缘算力设备,挖掘海量市场潜力。

四、核心技术创新,打造全场景最佳解决方案

1. 超节点 + 大 EP,破解大规模推理服务痛点

AI Agent 的普及带来百倍级 Tokens 需求和 10ms 级时延要求,传统服务器堆叠模式存在内存独立编址、跨节点交互性能开销大的问题。昇腾 384 超节点实现 48TB 内存统一编址、全局内存共享,共享内存容量较传统方式提升 96 倍,NPU 间通过内存语义直接交互,数据交互效率提升 3 倍,可实现更高 KVCache,满足 Agent 超长上下文需求,成为大规模推理的最优选择。

同时昇腾为伙伴提供三条灵活实现路径:复用 MindIE 成熟大 EP 方案快速部署、合入 vLLM/SGLang 开源推理引擎降低迁移成本、基于 CANN 深度定制极致性能推理引擎。目前硅基流动、清昴智能等伙伴已基于该能力打造推理引擎,为金融行业提供服务,实现多轮任务应答速度提升 3 倍。

2. 异步流式数据引擎 TQ,优化强化学习后训练

针对强化学习后训练场景,昇腾沉淀全流程最佳实践,提供一键部署的 Docker 镜像,解决业界普遍关注的训推资源调度难题。创新推出的 “异步流式数据引擎 TQ” 技术,实现控制流与数据流解耦,样本数据无需经控制器中转,依托超节点内存统一编址实现训推节点快速数据交互,端到端性能提升 40% 以上,该特性已合入 verl 社区并应用于广告、信贷风控等核心场景。

3. 软硬件全面升级,开源 Agent 参考设计打造 “Claw 一体机”

面向国计民生大模型应用场景,昇腾产品分级分档升级:百亿级模型适配 A2 标卡,内存带宽达业界 1.8 倍,实现 100ms 推理时延;千亿级模型搭配单机服务器,算力达业界 2.3 倍;万亿级模型采用双机超节点服务器,为业界唯一可部署 T 级模型的产品,算力达业界 3.78 倍,突破 20ms 低时延。

同时昇腾推出 Agentic 开源参考设计,打包优化后的推理引擎、开源模型权重及 OpenClaw 框架为完整镜像,伙伴只需聚焦业务集成与 Skill 开发,即可快速打造 Agent 应用一体机。基于双机超节点服务器的一体机,可实现每日 20 亿 Tokens 供给,目前已有 20 多家伙伴落地相关产品,服务教育、医疗、金融等核心领域。

4. Atlas 350 加速卡,赋能推荐 / 多模态 / LLM 三大推理场景

昇腾发布 Atlas 350 加速卡,搭载全新昇腾 950PR 处理器,性能较业界同类产品领先 1 至 1.4 倍,聚焦推荐、多模态、LLM 三大核心推理场景:算力内存双升级,单卡算力达业界 2.8 倍以上,支持 mxFP4 低精格式,片上内存最大 112GB,多模态生成性能提升 60%;访存粒度降至 128 字节,海量小算子访存效率提升 4 倍;支持 SIMT+SIMD 混合编程,开发更灵活,满足伙伴多样化需求。

五、深耕行业场景,技术与业务深度融合

2025 年 9 月,昇腾联合 20 多家 ISV 启动金融、能源等 5 大行业应用场景解决方案打造工作,半年内孵化出辅助办公、AI 实训、电子病历等十余个方案,落地 180 多家客户。其中在智慧文旅领域,联合海天瑞声、陕文投打造的多模态 AI 伴游助手 “小七”,已在陕西各大景点投放,为 400 多万游客提供个性化出游服务。

在智能边端领域,昇腾开放多档位、高集成度的模组 / 板卡,结合多 OS 兼容、多场景 SDK,使能伙伴打造多样化产品。软通华方、同泰怡等伙伴基于 Atlas 300I A2 打造的液冷 AI 工作站,具备静音、高密、省电等优势,成为科研仿真、医疗、金融等行业本地算力设备首选。

六、CANN 开源开放升级,降低创新门槛

昇腾 CANN 开源开放实现三大核心升级,进一步提升伙伴开发与部署效率:

- 部署效率升级:将原有 8 个大包拆分为 29 个独立组件,包大小从 2G 缩减至 0.43G,特性加载时间从 2 分钟缩短至 20 秒;

- 开发体验升级:实现主流算子编程框架无感对接,2026 年将开源 PyPTO 编程范式,使算子代码量平均减少 70%,可视化调试让复杂算子开发缩短至一周,同时提供开源 Skill 库支持算子自动生成 Agent;

- 社区资源升级:完善开源社区 CI/CD 流水线,2026 年 6 月将开放 2000 卡免费算力资源,大幅降低开发者创新门槛。

七、五大创新方向,共筑可持续 AI 产业生态

昇腾围绕硬件、算子、加速库、模型、应用五大创新方向,以社区化运作模式赋能伙伴发展:完善激励机制与知识体系,开放能力认证加速伙伴能力转型;下发丰富创新任务,设立 2000 万首批创新激励基金;深化昇腾万里伙伴计划,升级 5000 万 NRE 鼓励伙伴创新,创新成果将上架社区 AI 应用市场,实现联合推广、共享收益。

张迪煊表示,昇腾与伙伴已并肩走过 7 年 AI 发展之路,见证了行业从探索起步到场景落地的全过程。未来昇腾将持续以开源开放为核心,与更多伙伴携手打造可持续、有韧性的 AI 产业生态,共同推动行业智能化迈向新高度,共赢行业智能化时代新机遇。

版权声明:本文转载自鲲鹏昇腾开发者社区,仅用于行业资讯交流与技术分享,不代表本公司立场,不用于任何商业用途。版权归原作者及原出处所有,如有侵权,请联系我们及时删除